Что такое вероятность в информатике

Данный урок хочу посвятить теме «Измерение информации».

Выделяют следующие подходы к определению количества информации :

Данные подходы изучаются в школьном курсе информатики.

Вероятностный подход

Вероятностный подход связан с таким понятием как ВЕРОЯТНОСТЬ.

ВЕРОЯТНОСТЬ — это отношение количества тех наблюдений, при которых рассматриваемое событие наступило, к общему количеству наблюдений. Такая трактовка допустима в случае достаточно большого количества наблюдений или опытов.

Единицы измерения информации: бит, байт, кбайт и т.д.

За 1 бит информации принимают такое количество информации, которое находится в сообщении о том, что произошло одно событие из двух равновероятных.

1 бит — это количество информации, уменьшающее неопределенность знаний в два раза.

При РАВНОВЕРОЯТНОСТНОМ ПОДХОДЕ вероятности наступления того или иного события равны.

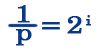

Для измерения количества информации, полученной нами при равновероятном событии, используем формулу

(где N — количество возможных исходов события (2 стороны в примере с монеткой),

i — количество информации, которое мы получим, при том или ином исходе события)

Другие задачи с разбором и для самостоятельного решения на тему «Вероятностный подход к измерению информации» смотрите в следующих выпусках.

При НЕРАВНОВЕРОЯТНОСТНОМ ПОДХОДЕ вероятности исходов событий не равны.

Пример: В коробке 16 карандашей. Из них 8 синих, 4 красных, 4 зеленых. Вероятность достать из коробки синий карандаш больше, чем вероятность достать зеленый или красный.

Для измерения количества информации при неравновероятностном подходе используют следующие формулы:

(где К — количество интересующих нас событий (достать синий карандаш K=8), N — общее количество события)

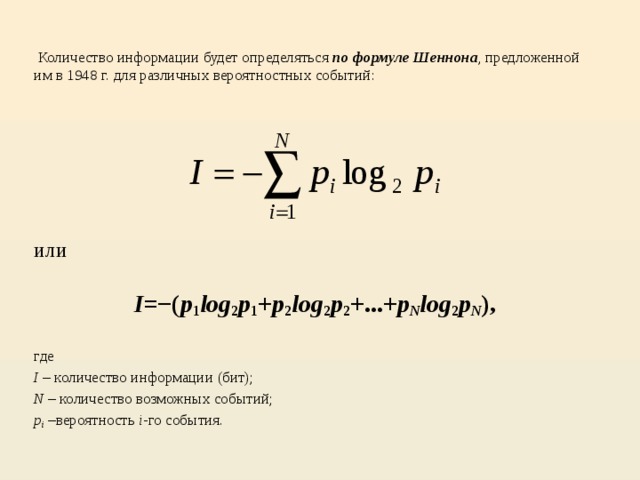

Вторая формула называется формулой Шеннона (правда в другом виде). В оригинале формула Шеннона выглядит так

Использование или неиспользовании этой формулы зависит от того, знают ли ученики про логарифм или нет.

Задача: В коробке 16 карандашей. Из них 8 синих, 4 красных, 4 зеленых. Сколько бит информации мы получим, вытащив из коробки синий карандаш?

Ответ : 1 бит информации мы получим, вытащив синий карандаш из коробки.

Продолжение рассмотрения этой темы смотрите в следующих постах.

Вероятность и информация

Эта презентация разработана к уроку информатики в 10 классе с углубленным изучением информатики по теме «Вероятность и информация»

Просмотр содержимого презентации

«вероятность и информация»

Сначала разберемся с понятием «вероятность». Введем следующие понятия:

Вероятностью случайного события ( p ) называется отношение числа благоприятствующих событию исходов (m) к общему числу исходов (n):

Заметим, что вероятность случайного события может изменяться от 0 до 1.

В беспроигрышной лотерее разыгрывается 3 книги, 2 альбома, 10 наборов маркеров, 10 блокнотов.

Какова вероятность выиграть книгу?

Общее число исходов 2+3+10+10=25; число благоприятствующих исходу событий равно 3. Вероятность выигрыша книги вычисляется по формуле: p =3/25=0,12.

Заметим, что во многих случаях события происходят с разной вероятностью, а значит формула N =2 i не всегда применима.

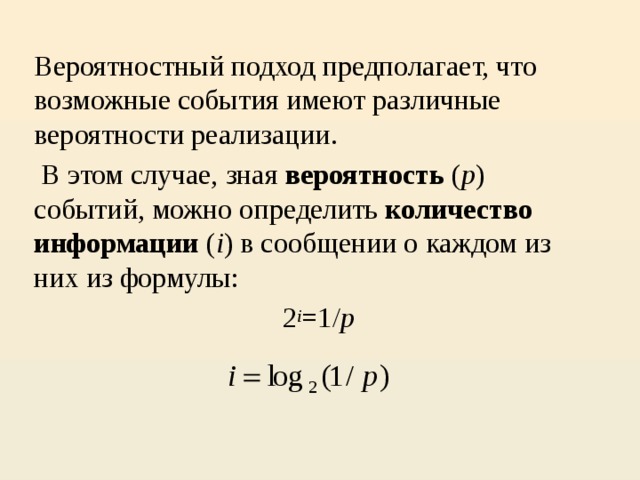

Вероятностный подход предполагает, что возможные события имеют различные вероятности реализации.

В этом случае, зная вероятность ( p ) событий, можно определить количество информации ( i ) в сообщении о каждом из них из формулы:

I – количество информации (бит);

N – количество возможных событий;

Качественная связь между вероятностью события и количеством информации в сообщении состоит в следующем: чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

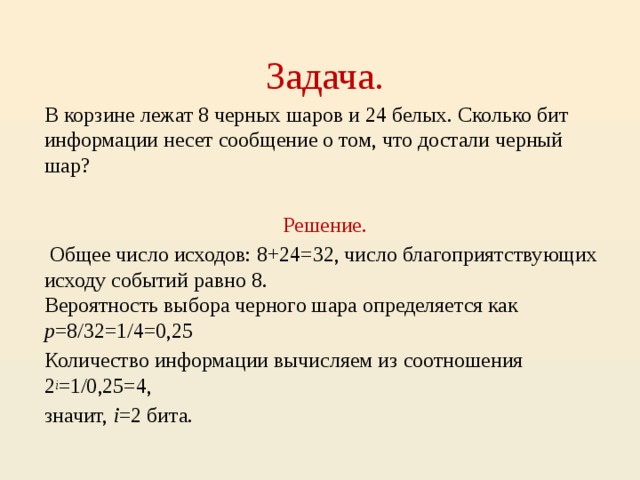

В корзине лежат 8 черных шаров и 24 белых. Сколько бит информации несет сообщение о том, что достали черный шар?

Общее число исходов: 8+24=32, число благоприятствующих исходу событий равно 8. Вероятность выбора черного шара определяется как p =8/32=1/4=0,25

Количество информации вычисляем из соотношения 2 i =1/0,25=4,

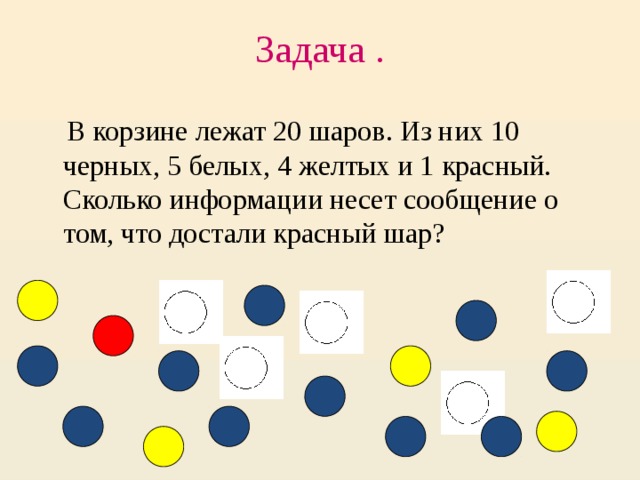

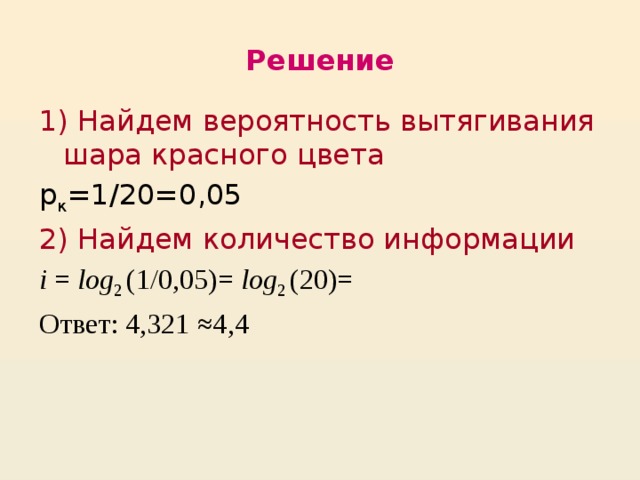

В корзине лежат 20 шаров. Из них 10 черных, 5 белых, 4 желтых и 1 красный. Сколько информации несет сообщение о том, что достали красный шар?

1) Найдем вероятность вытягивания шара красного цвета

2) Найдем количество информации

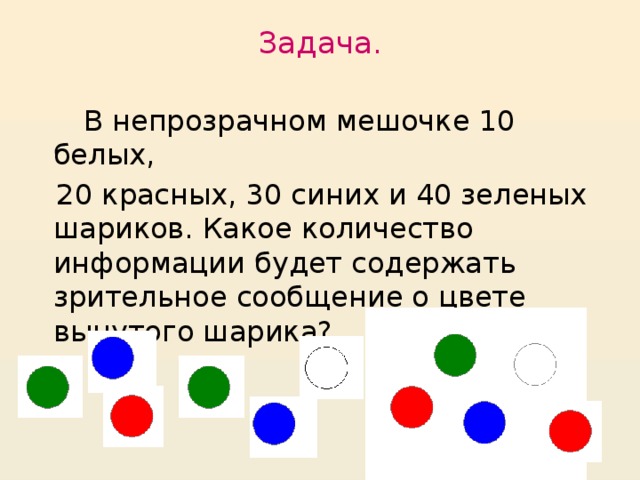

В непрозрачном мешочке 10 белых,

20 красных, 30 синих и 40 зеленых шариков. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика?

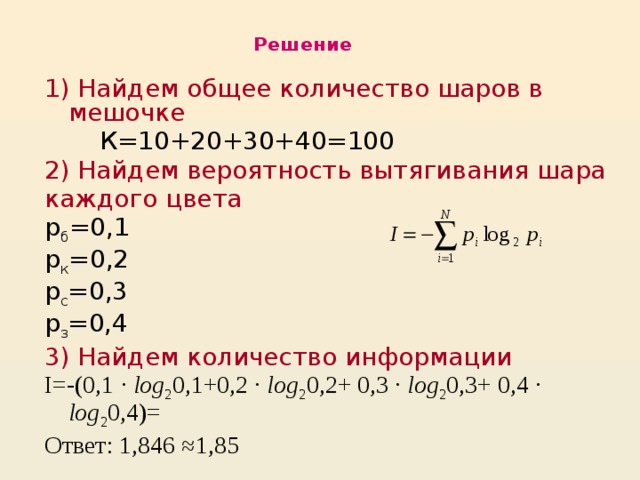

1) Найдем общее количество шаров в мешочке

2) Найдем вероятность вытягивания шара

3) Найдем количество информации

I=-(0,1 · log 2 0,1+0,2 · log 2 0,2+ 0,3 · log 2 0,3+ 0,4 · log 2 0,4)=

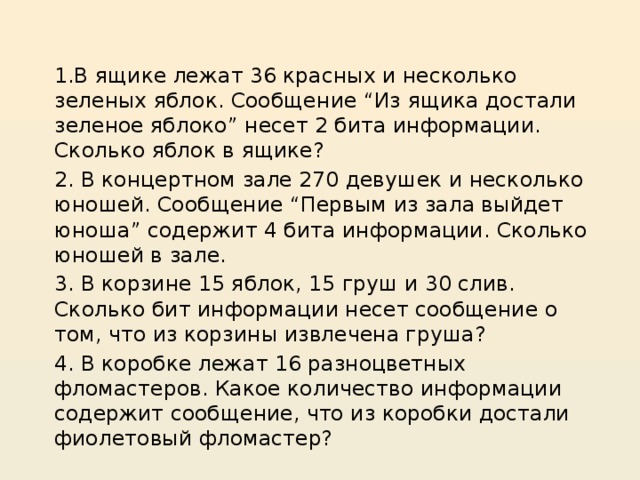

1.В ящике лежат 36 красных и несколько зеленых яблок. Сообщение “Из ящика достали зеленое яблоко” несет 2 бита информации. Сколько яблок в ящике?

2. В концертном зале 270 девушек и несколько юношей. Сообщение “Первым из зала выйдет юноша” содержит 4 бита информации. Сколько юношей в зале.

3. В корзине 15 яблок, 15 груш и 30 слив. Сколько бит информации несет сообщение о том, что из корзины извлечена груша?

4. В коробке лежат 16 разноцветных фломастеров. Какое количество информации содержит сообщение, что из коробки достали фиолетовый фломастер?

Вероятностный подход к определению количества информации «Формула Шеннона. Применение ЭТ Excel для решения задач на нахождение количества информации»

Материал разработан на 2 спаренных урока.

Цели уроков: Сформировать у учащихся понимание вероятности, равновероятных событий и событий с различными вероятностями. Научить находить количество информации, используя вероятностный подход. Создать в Excel информационную модель для автоматизации процесса вычислений в задачах на нахождение количества информации, используя формулу Шеннона.

Требования к знаниям и умениям:

Учащиеся должны знать:

Учащиеся должны уметь:

Оборудование: доска, компьютер, мультимедийный проектор, карточки с заданиями, карточки-памятки, справочный материал.

Урок 1. Вероятностный подход к определению количества информации. Формула Шеннона

Ход урока

I. Организационный момент.

II. Проверка домашнего задания.

III. Постановка цели урока.

Задача: Какое сообщение содержит большее количество информации?

Первые три варианта учащиеся решают без затруднения. События равновероятны, поэтому можно применить для решения формулу Хартли. Но третье задание вызывает затруднение. Делаются различные предположения. Роль учителя: подвести учащихся к осмыслению, что в четвертом варианте мы сталкиваемся с ситуацией, когда события неравновероятны. Не все ситуации имеют одинаковые вероятности реализации. Существует много таких ситуаций, у которых вероятности реализации различаются. Например, если бросают несимметричную монету или «правило бутерброда».

Сегодня на уроке мы должны ответить на вопрос: как вычислить количество информации в сообщении о неравновероятном событии.

IV. Объяснение нового материала.

Для вычисления количества информации в сообщении о неравновероятном событии используют следующую формулу: I=log2(1/p)

где I – это количество информации, р – вероятность события.

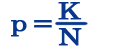

Вероятность события выражается в долях единицы и вычисляется по формуле: р=K/N,

где К – величина, показывающая сколько раз произошло интересующее нас событие, N – общее число возможных исходов какого-то процесса.

Вернемся к нашей задаче.

Пусть К1 – это количество пирожков с повидлом, К1=24

К2 – количество пирожков с капустой, К2=8

N – общее количество пирожков, N = К1 +К2=24+8=32

Вычислим вероятность выбора пирожка с разной начинкой и количество информации, которое при этом было получено.

Вероятность выбора пирожка с повидлом: р1=24/32=3/4=0,75.

Вероятность выбора пирожка с капустой: р2=8/32=1/4=0,25.

Обращаем внимание учащихся на то, что в сумме все вероятности дают 1.

Вычислим количество информации, содержащееся в сообщении, что Маша выбрала пирожок с повидлом: I1=log2(1/p1)= log2(1/0,75)= log21,3=1,15470 бит.

Вычислим количество информации, содержащееся в сообщении, если был выбран пирожок с капустой: I2=log2(1/p2)= log2(1/0,25)= log24=2 бит.

Пояснение: если учащиеся не умеют вычислять значение логарифмической функции, то можно использовать при решении задач этого урока следующие приемы:

Приложение 1. «Количество информации в сообщении об одном из N равновероятных событий: I= log2N». (Приложение вы можете получить у автора статьи.)

При сравнении результатов вычислений получается следующая ситуация: вероятность выбора пирожка с повидлом больше, чем с капустой, а информации при этом получилось меньше. Это не случайность, а закономерность.

Качественную связь между вероятностью события и количеством информации в сообщении об этом событии можно выразить так: чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

Вернемся к нашей задаче с пирожками. Мы еще не ответили на вопрос: сколько получим информации при выборе пирожка любого вида?

Ответить на этот вопрос нам поможет формула вычисления количества информации для событий с различными вероятностями, которую предложил в 1948 г. американский инженер и математик К.Шеннон.

можно расписать формулу в таком виде:

Рассмотрим формулу на нашем примере:

Теперь мы с вами можем ответить на вопрос задачи, которая была поставлена в начале урока. Какое сообщение содержит большее количество информации?

Ответ: в 1 сообщении.

Обратите внимание на 3 и 4 задачу. Сравните количество информации.

Мы видим, что количество информации достигает максимального значения, если события равновероятны.

Интересно, что рассматриваемые нами формулы классической теории информации первоначально были разработаны для технических систем связи, призванных служить обмену информацией между людьми. Работа этих систем определяется законами физики т.е. законами материального мира. Задача оптимизации работы таких систем требовала, прежде всего, решить вопрос о количестве информации, передаваемой по каналам связи. Поэтому вполне естественно, что первые шаги в этом направлении сделали сотрудники Bell Telephon Companie – X. Найквист, Р. Хартли и К. Шеннон. Приведенные формулы послужили К. Шеннону основанием для исчисления пропускной способности каналов связи и энтропии источников сообщений, для улучшения методов кодирования и декодирования сообщений, для выбора помехоустойчивых кодов, а также для решения ряда других задач, связанных с оптимизацией работы технических систем связи. Совокупность этих представлений, названная К. Шенноном “математической теорией связи”, и явилась основой классической теории информации. (Дополнительный материал можно найти на сайте http://polbu.ru/korogodin_information или прочитав книгу В.И. Корогодин, В.Л. Корогодина. Информация как основа жизни. Формула Шеннона.)

Можно ли применить формулу К. Шеннона для равновероятных событий?

Мы видим, что формула Хартли является частным случаем формулы Шеннона.

V. Закрепление изучаемого материала.

Задача: В корзине лежат 32 клубка красной и черной шерсти. Среди них 4 клубка красной шерсти.

Сколько информации несет сообщение, что достали клубок красной шерсти? Сколько информации несет сообщение, что достали клубок шерсти любой окраски?

Дано: Кк=4;N=32

Найти: Iк, I

Решение:

VI. Подведение итогов урока.

Урок 2. Применение ЭТ Excel для решения задач на нахождение количества информации

Пояснение: При решении задач на нахождение количества информации учащиеся не вычисляли значение логарифма, т.к. не знакомы с логарифмической функцией. Урок строился таким образом: сначала решались однотипные задачи с составлением формул, затем разрабатывалась табличная модель в Excel, где учащиеся делали вычисления. В конце урока озвучивались ответы к задачам.

Ход урока

I. Постановка целей урока

На этом уроке мы будем решать задачи на нахождение количества информации в сообщении о неравновероятных событиях и автоматизируем процесс вычисления задач данного типа.

Для решения задач на нахождение вероятности и количества информации используем формулы, которые вывели на прошлом уроке:

рi=Ki/N; Ii=log2(1/pi);

II. Решение задач.

Ученикам дается список задач, которые они должны решить.

Задачи решаются только с выводами формул, без вычислений.

В озере обитает 12500 окуней, 25000 пескарей, а карасей и щук по 6250. Какое количество информации несет сообщение о ловле рыбы каждого вида. Сколько информации мы получим, когда поймаем какую-нибудь рыбу?

Решение:

III. Объяснение нового материала.

Задается вопрос ученикам:

1. Какие трудности возникают при решении задач данного типа? (Отв.: Вычисление логарифмов).

2. Нельзя ли автоматизировать процесс решения данных задач? (Отв.: можно, т.к. алгоритм вычислений в этих задачах один и тот же).

3. Какие программы используются для автоматизации вычислительного процесса? (Отв.: ЭТ Excel).

Давайте попробуем сделать табличную модель для вычисления задач данного типа.

Нам необходимо решить вопрос, что мы будем вычислять в таблице. Если вы внимательно присмотритесь к задачам, то увидите, что в одних задачах надо вычислить только вероятность событий, в других количество информации о происходящих событиях или вообще количество информации о событии.

Мы сделаем универсальную таблицу, где достаточно занести данные задачи, а вычисление результатов будет происходить автоматически.

Структура таблицы обсуждается с учениками. Роль учителя обобщить ответы учащихся.

При составлении таблицы мы должны учитывать:

Прежде чем демонстрировать заполнение таблицы, учитель повторяет правила ввода формул, функций, операцию копирования (домашнее задание к этому уроку).

При заполнении таблицы показывает как вводить логарифмическую функцию. Для экономии времени учитель демонстрирует уже готовую таблицу, а ученикам раздает карточки-памятки по заполнению таблицы.

Рассмотрим заполнение таблицы на примере задачи №1.

Рис. 1. Режим отображения формул

Рис. 2. Отображение результатов вычислений

Результаты вычислений занести в тетрадь.

Если в решаемых задачах количество событий больше или меньше, то можно добавить или удалить строчки в таблице.

VI. Практическая работа.

1. Сделать табличную модель для вычисления количества информации.

2. Используя табличную модель, сделать вычисления к задаче №2 (рис.3), результат вычисления занести в тетрадь.

3. Используя таблицу-шаблон, решить задачи №3,4 (рис.4, рис.5), решение оформить в тетради.

4. Сохранить таблицы в своих папках под именем «инф_вероятность».

В классе 30 человек. За контрольную работу по информатике получено 15 пятерок, 6 четверок, 8 троек и 1 двойка. Какое количество информации несет сообщение о том, что Андреев получил пятерку?

В коробке лежат кубики: 10 красных, 8 зеленых, 5 желтых, 12 синих. Вычислите вероятность доставания кубика каждого цвета и количество информации, которое при этом будет получено.

В непрозрачном мешочке хранятся 10 белых, 20 красных, 30 синих и 40 зеленых шариков. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика?

VII. Подведение итогов урока.

Учитель оценивает работу каждого ученика. Оценивается не только практическая работа на компьютере, но и оформление решения задачи в тетради.

VIII. Домашняя работа.

1. Параграф учебника «Формула Шеннона», компьютерный практикум после параграфа.

2. Доказать, что формула Хартли – частный случай формулы Шеннона.

Литература:

Количество информации и вероятность

ИЗМЕРЕНИЕ ИНФОРМАЦИИ

Содержательный подход.

Количество информации, заключенное в сообщении, определяется объемом знаний, который несет это сообщение получающему его человеку. Сообщение содержит информацию для человека, если заключенные в нем сведения являются для этого человека новыми и понятными и, следовательно, пополняют его знания.

При содержательном подходе возможна качественная оценка информации: полезная, безразличная, важная, вредная. Одну и ту же информацию разные люди могут оценить по разному.

Единица измерения количества информации называется бит. Сообщение, уменьшающее неопределенность знаний человека в два раза, несет для него 1 бит информации.

Пусть в некотором сообщении содержатся сведения о том, что произошло одно из N равновероятных событий (равновероятность обозначает, что ни одно событие не имеет преимуществ перед другими). Тогда количество информации, заключенное в этом сообщении, – хбит и число N связаны формулой: 2 x =N

Данная формула является показательным уравнением относительно неизвестной х. Из математики известно, что решение такого уравнения имеет вид: x=log2N

– логарифм от N по основанию 2. Если N равно целой степени двойки (2, 4, 8, 16 и т.д.), то такое уравнение можно решить «в уме». В противном случае количество информации становится нецелой величиной.

Пример 1. При бросании монеты сообщение о результате жребия (например, выпал орел) несет 1 бит информации, поскольку количество возможных вариантов результата равно 2 (орел или решка). Оба эти варианта равновероятны. Ответ может быть получен из решения уравнения: 2 x = 2, откуда, очевидно, следует: х = 1 бит.

Вывод: в любом случае сообщение об одном событии из двух равновероятных несет 1 бит информации.

Пример 2. В барабане для розыгрыша лотереи находится 32 шара. Сколько информации содержит сообщение о первом выпавшем номере (например, выпал номер 15)? Поскольку вытаскивание любого из 32 шаров равновероятно, то количество информации об одном выпавшем номере находится из уравнения: 2 х = 32.

Пример 3. При игре в кости используется кубик с шестью гранями. Сколько бит информации получает игрок при каждом бросании кубика? Выпадение каждой грани кубика равновероятно. Поэтому количество информации от одного результата бросания находится из уравнения: 2 х = 6.

Решение этого уравнения:

Задачи

№ 1.«Вы выходите на следующей остановке?» – спросили человека в автобусе. «Нет», – ответил он. Сколько информации содержит ответ?

№ 2.Какой объем информации содержит сообщение, уменьшающее неопределенность знаний в 4 раза?

№ 3.Вы подошли к светофору, когда горел желтый свет. После этого загорелся зеленый. Какое количество информации вы при этом получили?

№ 4.Вы подошли к светофору, когда горел красный свет. После этого загорелся желтый свет. Сколько информации вы при этом получили?

№ 5.Группа школьников пришла в бассейн, в котором 4 дорожки для плавания. Тренер сообщил, что группа будет плавать на дорожке номер 3. Сколько информации получили школьники из этого сообщения?

№ 6.В корзине лежат 8 шаров. Все шары разного цвета. Сколько информации несет сообщение о том, что из корзины достали красный шар?

№ 7.Была получена телеграмма: «Встречайте, вагон 7». Известно, что в составе поезда 16 вагонов. Какое количество информации было получено?

№ 8.В школьной библиотеке 16 стеллажей с книгами. На каждом стеллаже 8 полок. Библиотекарь сообщил Пете, что нужная ему книга находится на пятом стеллаже на третьей сверху полке. Какое количество информации библиотекарь передал Пете?

№ 9.При угадывании целого числа в диапазоне от 1 до N было получено 7 бит информации. Чему равно N?

№ 10.При угадывании целого числа в некотором диапазоне было получено 6 бит информации. Сколько чисел содержит этот диапазон?

№ 11.Сообщение о том, что ваш друг живет на 10 этаже, несет 4 бита информации. Сколько этажей в доме?

№ 12.Какое количество информации несет сообщение: «Встреча назначена на сентябрь».

Алфавитный подход

Алфавитный подход к измерению информации позволяет определить количество информации, заключенной в тексте. Алфавитный подход является объективным, т.е. он не зависит от субъекта (человека), воспринимающего текст.

где N – мощность алфавита. Следовательно, в 2-х символьном алфавите каждый символ «весит» 1 бит (2=2 1 ); в 4-х символьном алфавите каждый символ несет 2 бита информации (4=2 2 ); в 8-ми символьном – 3 бита (8=2 3 ) и т.д.

Один символ из алфавита мощностью 256 (2 8 ) несет в тексте 8 бит информации. Такое количество информации называется байт. Алфавит из 256 символов используется для представления текстов в компьютере. 1 байт = 8 бит.

Если весь текст состоит из К символов, то при алфавитном подходе размер содержащейся в нем информации равен: I = К х i,

где i – информационный вес одного символа в используемом алфавите.

Для измерения информации используются и более крупные единицы:

1 Кбайт (килобайт) = 210 байт = 1024 байта

1 Мбайт (мегабайт) = 210 Кбайт = 1024 Кбайта

1 Гбайт (гигабайт) = 210 Мбайт = 1024 Мбайта

Пример 4. Книга, набранная с помощью компьютера, содержит 150 страниц; на каждой странице – 40 строк, в каждой строке – 60 символов. Каков объем информации в книге?

Решение. Мощность компьютерного алфавита равна 256. Один символ несет 1 байт информации. Значит, страница содержит 40 х 60 = 2400 байт информации. Объем всей информации в книге (в разных единицах):

2400 х 150 = 360 000 байт.

360000/1024 = 351,5625 Кбайт.

351,5625/1024 = 0,34332275 Мбайт.

Задачи

№ 1.Алфавит племени Мульти состоит из 8 букв. Какое количество информации несет одна буква этого алфавита?

№ 2.Сообщение, записанное буквами из 64-х символьного алфавита, содержит 20 символов. Какой объем информации оно несет?

№ 3.Племя Мульти имеет 32-х символьный алфавит. Племя Пульти использует 64-х символьный алфавит. Вожди племен обменялись письмами. Письмо племени Мульти содержало 80 символов, а письмо племени Пульти – 70 символов. Сравните объемы информации, содержащейся в письмах.

№ 4.Информационное сообщение объемом 1,5 Кбайта содержит 3072 символа. Сколько символов содержит алфавит, при помощи которого было записано это сообщение?

№ 5.Объем сообщения, содержащего 2048 символов, составил 1/512 часть Мбайта. Каков размер алфавита, с помощью которого записано сообщение?

№ 6.Сколько символов содержит сообщение, записанное с помощью 16-ти символьного алфавита, если объем его составил 1/16 часть Мбайта?

№ 7.Сколько килобайтов составляет сообщение, содержащее 12288 битов?

№ 8.Сколько килобайтов составит сообщение из 384 символов 16-ти символьного алфавита?

№ 9.Для записи текста использовался 256-символьный алфавит. Каждая страница содержит 30 строк по 70 символов в строке. Какой объем информации содержат 5 страниц текста?

№ 10.Сообщение занимает 3 страницы по 25 строк. В каждой строке записано по 60 символов. Сколько символов в использованном алфавите, если все сообщение содержит 1125 байтов?

№ 11.Для записи сообщения использовался 64-х символьный алфавит. Каждая страница содержит 30 строк. Все сообщение содержит 8775 байтов информации и занимает 6 страниц. Сколько символов в строке?

№ 12.Сообщение занимает 2 страницы и содержит 1/16 Кбайта информации. На каждой станице записано 256 символов. Какова мощность использованного алфавита?

Количество информации и вероятность

Рассмотрим несколько примеров.

Пример 1. В коробке имеется 50 шаров. Из них 40 белых и 10 черных. Очевидно, вероятность того, что при вытаскивании «не глядя» попадется белый шар больше, чем вероятность попадания черного.

Решение. Обозначим рч – вероятность попадания при вытаскивании черного шара, рб – вероятность попадания белого шара. Тогда:

Отсюда видно, что вероятность попадания белого шара в 4 раз больше, чем черного.

Пример 2. Сережа – лучший ученик в классе. Вероятность того, что за контрольную по математике Сережа получит «5» больше, чем вероятность получения двойки.

Решение. Представим себе, что мы изучили успеваемость Сережи за несколько лет учебы. За это время он получил по математике 100 оценок. Из них: 60 пятерок, 30 четверок, 8 троек и 2 двойки. Допуская, что такое распределение оценок может сохраниться и в дальнейшем, вычислим вероятность получения каждой из оценок.

Пример 3. В пруду живут 8000 карасей, 2000 щук и 40 000 пескарей. Самая большая вероятность для рыбака – поймать в этом пруду пескаря, на втором месте – карась, на третьем – щука.

Решение. Всего в пруду обитают 50000 рыб. Из предыдущих примеров можно догадаться, что вероятность попадания на удочку каждого из видов рыб равна его доле в общем количестве. Отсюда: рк = 8000/50000 = 0,16;

Из рассмотренных примеров можно сделать вывод: если N – это общее число возможных исходов какого-то процесса (вытаскивание шара, получение оценки, ловля рыбы), и из них интересующее нас событие (вытаскивание белого шара, получение пятерки, попадание щуки) может произойти К раз, то вероятность этого события равна K/N.

Вероятность выражается в долях единицы. В частном случае, вероятность достоверного события равна 1 (из 50 белых шаров вытащен белый шар); вероятность невозможного события равна нулю (из 50 белых шаров вытащен черный шар).

Качественную связь между вероятностью события и количеством информации в сообщении об этом событии можно выразить так: чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

Например, сообщение о том, что Сережа получил двойку по математике, содержит больше информации для тех, кто его знает, чем сообщение о пятерке. Сообщение, что рыбак поймал в пруду щуку, более информативно, чем сообщение о том, что на удочку попался пескарь. Количественная зависимость между вероятностью события (р) и количеством информации в сообщении о нем (i) выражается формулой:

Пример 4. В задаче о шарах определим количество информации в сообщении о попадании белого шара и черного шара:

Вероятностный метод применим и для алфавитного подхода к измерению информации, заключенной в тексте. Известно, что разные символы (буквы алфавита, знаки препинания и др.) встречаются в тексте с разной частотой и, следовательно, имеют разную вероятность. Значит, измерять информационный вес каждого символа в тексте так, как это делалось раньше (в предположении равновероятности), нельзя.

Пример 5. В алфавите племени МУМУ всего 4 буквы (А, У, М, К), один знак препинания (точка) и для разделения слов используется пробел. Подсчитали, что в популярном романе «Мумука» содержится всего 10000 знаков, из них: букв А – 4000, букв У – 1000, букв М – 2000, букв К – 1500, точек – 500, пробелов – 1000. Какой объем информации содержит книга?

Решение.Поскольку объем книги достаточно большой, то можно допустить, что вычисленная по ней частота встречаемости в тексте каждого из символов алфавита характерна для любого текста языке МУМУ. Подсчитаем частоту встречаемости каждого символа во всем тексте книги (т.е. вероятность) и информационные веса символов:

буква А: 4000/10000 = 0,4; iA=log 2 (1/0,4) = 1,321928;

буква У: 1000/10000 = 0,1; iУ=log 2 (1/0,1) = 3,1928;

буква М: 2000/10000 = 0,2; iМ=log 2 (1/0,2) = 2,321928;

буква К: 1500/10000 = 0,15; iК=log 2 (1/0,15) = 2,736966;

точка: 500/10000 = 0,05; iточка=log 2 (1/0,05) = 4,321928;

пробел: 1000/10000 = 0,1; iпробел=log 2 (1/0,1) = 3,321928.

Общий объем информации в книге вычислим как суму произведений информационного веса каждого символа на число повторений этого символа в книге:

Задачи

№ 1.В корзине лежат 8 черных шаров и 24 белых. Сколько информации несет сообщение о том, что достали черный шар?

№ 2.В корзине лежат 32 клубка шерсти. Среди них – 4 красных. Сколько информации несет сообщение о том, что достали клубок красной шерсти?

№ 3.В коробке лежат 64 цветных карандаша. Сообщение о том, что достали белый карандаш, несет 4 бита информации. Сколько белых карандашей было в корзине?

№ 4.В ящике лежат перчатки (белые и черные). Среди них – 2 пари черных. Сообщение о том, что из ящика достали пару черных перчаток, несет 4 бита информации. Сколько всего пар перчаток было в ящике?

№ 6.Известно, что в ящике лежат 20 шаров. Из них 10 – черных, 5 – белых, 4 – желтых и 1 – красный. Какое количество информации несут сообщения о том, что из ящика случайным образом достали черный шар, белый шар, желтый шар, красный шар?

№ 7.За четверть ученик получил 100 оценок. Сообщение о том, что он получил четверку, несет 2 бита информации. Сколько четверок ученик получил за четверть?

№ 8.В корзине лежат белые и черные шары. Среди них 18 черных шаров. Сообщение о том, что из корзины достали белый шар, несет 2 бита информации. Сколько всего в корзине шаров?

№ 9.Частотный словарь русского языка – словарь вероятностей (частот) появления букв в произвольном тексте – приведен ниже. Определите, какое количество информации несет каждая буква этого словаря.

| Символ | Частота | Символ | Частота | Символ | Частота | Символ | Частота |

| о | 0.090 | в | 0.035 | я | 0.018 | ж | 0.007 |

| е, ё | 0.072 | к | 0.028 | ы, з | 0.016 | ю, ш | 0.006 |

| а, и | 0.062 | м | 0.026 | ь, ъ, б | 0.014 | ц, щ, э | 0.003 |

| т,н | 0.053 | д | 0.025 | ч | 0.013 | ф | 0.002 |

| с | 0.045 | п | 0.023 | й | 0.012 | ||

| р | 0.040 | у | 0.021 | х | 0.009 |

№ 10.Используя результат решения предыдущей задачи, определите количество информации в слове «ИНФОРМАТИКА».

№ 11.Используя решение задачи №10, определите количество информации в фразе «ПОВТОРЕНИЕ – МАТЬ УЧЕНИЯ».

4. Продолжите последовательность:

4) о, д, т, ч, п, ш, с, в, д, д,

5. Черный ящик.Задумано правило обработки информации – «черный ящик». Это устройство преобразует входную последовательность символов в выходную последовательность. По заданным примерам установите правило работы черного ящика.